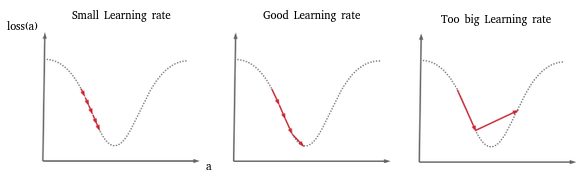

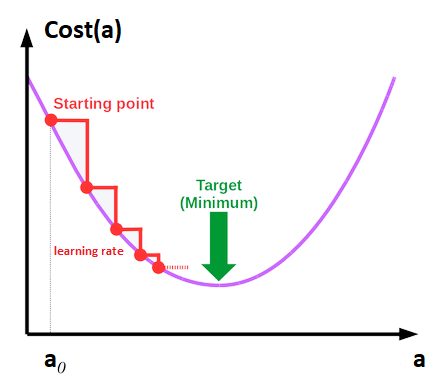

Une fois terminé l’article sur la descente de gradient, je me suis rendu compte qu’il manquait deux points important. Le premier concerne l’approche stochastique dés lors que l’on a des jeux de données trop importants, le second étant de voir très concrètement ce qui se produit quand on choisit mal la valeur du learning rate. Je vais donc profiter de cet article pour finalement continuer l’article précédent 😉

Descente de Gradient Stochastique (SGD) & Learning RateCatégorie : Modélisation

La modélisation est une étape cruciale lors de la création d’une IA. Cette catégorie aborde les différents algorithmes du Machine Learning, les réseaux de neurones mais aussi les différentes métriques qui permettent d’évaluer un modèle.

La descente de gradient

Comment parler de Machine Learning ou même de Deep Learning sans aborder la – fameuse – descente de gradient ? Il y a beaucoup d’articles sur ce sujet bien sur mais bien souvent il faut lire plusieurs afin de bien en comprendre tous les mécanismes. Souvent trop mathématiques ou pas assez, je vais essayer surtout ici d’expliquer son fonctionnement en douceur et pas à pas afin de tenter une démystification du sujet.

La descente de gradientBiais & Variance … dilemme ou compromis ?

Dés lors que vous allez commencer à mettre au point des modèles de Machine Learning vous aller vous confronter au délicat problème d'équilibre dans l'ajustement du biais et de la variance. Dans cet article je vous explique simplement comment mieux les comprendre et les ajuster.

Biais & Variance … dilemme ou compromis ?Les chaînes de Markov

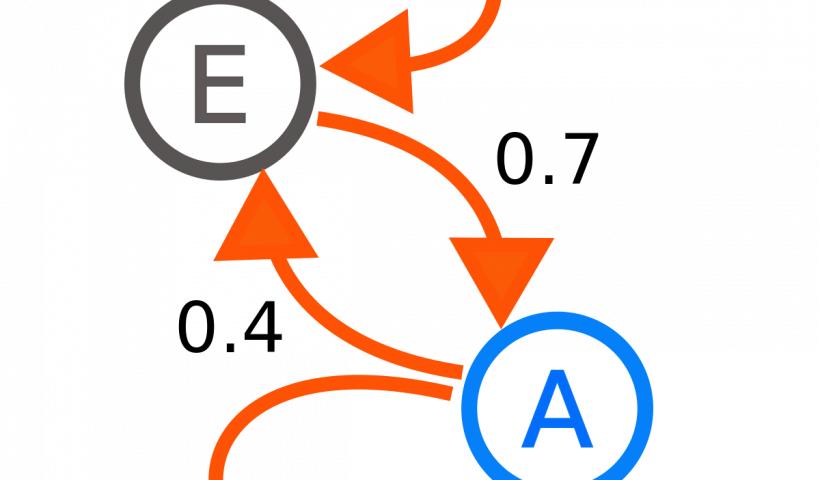

Si cette méthode de « prédiction » basée sur les probabilités et les états/transitions a eu ses heures de gloire, elle semble aujourd'hui moins à la mode. Dans cet article nous reviendrons sur les principes fondamentaux des chaines de Markov et leur application en Python.

Les chaînes de Markov