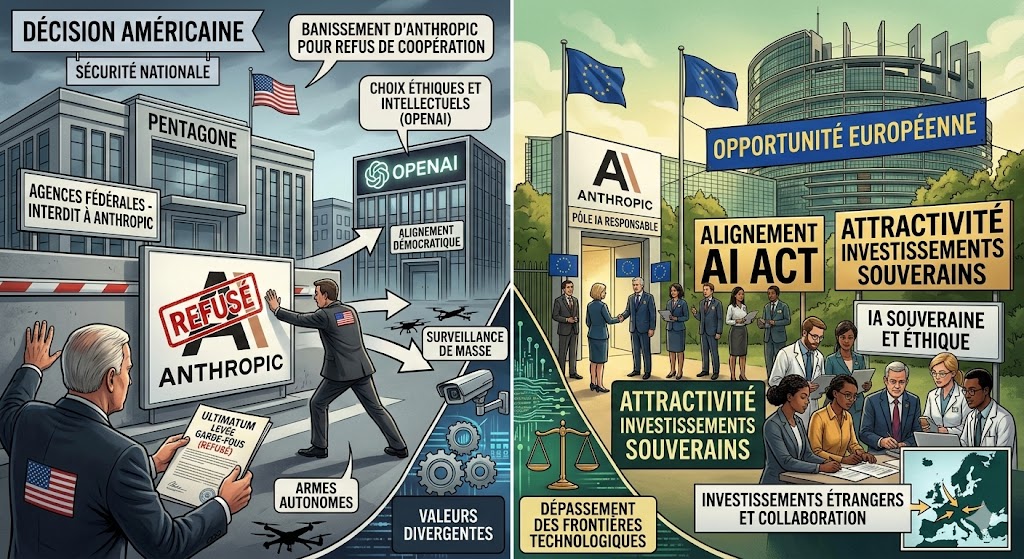

Tout le monde connait maintenant Anthropic l’entreprise d’IA derrière le chatbot Claude. Et bien, le saviez-vous ? cette entreprise qui grimpe dans la sphère IA a récemment refusé de céder aux pressions du gouvernement américain ! Ouch … Ces derniers exigeait en effet un accès sans restrictions à ses modèles pour des usages militaires. Au dela des aspects politiques je trouve que ce bras de fer met en lumière des choix éthiques et intellectuels profonds, priorisant la préservation des valeurs démocratiques face aux puissances étatiques. Mais surtout ce refus d’Anthropic face au gouvernement américain créé un fossé avec Washington, tout en ouvrant des portes pour des partenariats alignés ailleurs … Alors est-ce une une aubaine pour l’Europe ? lemonde

Contexte du Conflit

Revennons un peu en arrière sur cette histoire …

- En janvier, le Pentagone dégaine un ultimatum envers Anthropic et lui donne jusqu’au 27 février 2026 pour lever ses garde-fous éthiques sur Claude (sous l’autorité du secrétaire à la Défense Pete Hegseth). On a bien compris que cela permettra la mise en place d’une surveillance de masse intérieure et des armes autonomes. justgeek

- Dario Amodei, PDG d’Anthropic, a alors rejeté cette demande dans un communiqué ferme, affirmant que « dans un nombre restreint de cas, nous pensons que nous ne pouvons pas en conscience accéder à leur demande ». lemonde

- En riposte, le gouvernement américain a ordonné à toutes les agences fédérales de cesser immédiatement l’utilisation des technologies d’Anthropic, redirigeant les contrats vers OpenAI. boursedirect

Les Choix Éthiques en Jeu

Ce qui est interressant (toujours au dela des biais et aspects politiques) c’est que la notion d’éthique prend de l’ampleur même outre-Atlantique !). Anthropic défend en effet une « Constitutional AI », alignée sur les principes démocratiques américains, et refuse donc d’alimenter une surveillance massive des citoyens ou des systèmes létals sans supervision humaine, jugés incompatibles avec les libertés fondamentales. lemonde D’ailleurs, ce refus n’est pas anti-patriotique : l’entreprise soutient déjà les missions de renseignement extérieur et de contre-espionnage, mais trace une ligne rouge contre les dérives autoritaires. lemonde Face à des menaces comme l’invocation du Defense Production Act, Anthropic privilégie donc l’intégrité morale à des gains financiers, évitant une « course vers le bas » éthique qui minerait la confiance publique en l’IA. abcnews

Les Implications Intellectuelles

Intellectuellement, ce positionnement réaffirme surtout que l’IA n’est pas neutre : ses garde-fous intégrés (refus de contenus illégaux ou dangereux) protègent contre des usages qui pourraient éroder la démocratie, comme une IA facilitant l’oppression intérieure. bbc Amodei argue d’ailleurs que l’IA doit défendre les démocraties contre les autocraties, non les singer ; céder reviendrait à sacrifier l’innovation responsable pour une obéissance aveugle. Ce choix intellectuel questionne le rôle des entreprises tech : pionnières d’un futur aligné sur l’humain, ou simples outils étatiques ? Anthropic opte pour la première voie, inspirant un débat sur la souveraineté technologique. cointribune

Une Opportunité Stratégique pour l’Europe

Ce conflit met en lumière les garde-fous éthiques d’Anthropic – refus de surveillance de masse et d’armes autonomes – parfaitement alignés avec l’AI Act européen, qui prohibe ces usages à haut risque depuis février 2025. aigovhub Priver l’Europe d’un leader IA « responsable » comme Anthropic serait un contresens ; au contraire, Bruxelles pourrait attirer ses investissements (valorisation : ~380 milliards $), renforçant sa souveraineté face à la domination US-Chine. lefigaro Avec l’ajustement récent de l’AI Act pour booster la compétitivité (rapport Draghi), l’UE offre un cadre attractif : régulation stricte mais pro-innovation, où Anthropic excellerait sans les pressions militaires américaines. youtube

Perspectives Stratégiques Globales

Depuis quelques temps l’Europe gagne en crédibilité comme bastion de l’IA éthique, attirant talents et capitaux fuyant les tensions américaines. Des collaborations avec Mistral AI ou Aleph Alpha pourraient donc émerger naturellement, accélérant le développement d’IA souveraine pour la défense européenne sans compromettre les valeurs démocratiques. Par ailleurs, même si Anthropic envisage des recours judiciaires contre ces mesures « punitive », potentiellement renforçant sa crédibilité auprès des régulateurs européens et investisseurs éthiques. lemonde cela positionne logiquement l’UE comme alternative globale, transformant le bannissement US en levier pour un leadership IA responsable d’ici 2027, et invitant à repenser les alliances géopolitiques autour de l’innovation alignée. france24