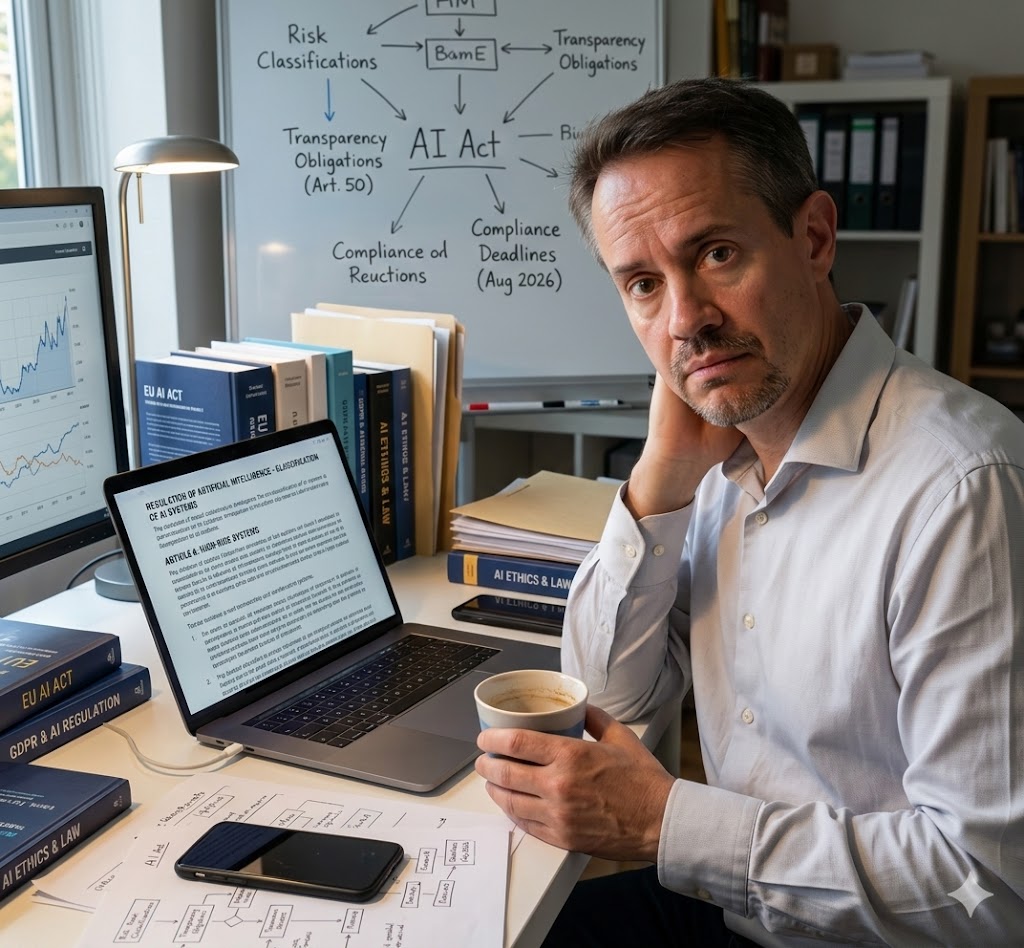

C’est lundi matin, 8h, café en main. Comme tous les matins de la semaine, vous ouvrez votre laptop et vous dites : “Bon, aujourd’hui, je deviens un citoyen modèle de l’UE. Fini les usages sauvages de l’IA, on passe en mode conformité AI Act !” Spoiler Alert: 24 heures plus tard, mon assistante IA me suggère poliment de me remplacer par… elle-même. … Bienvenue dans mon cauchemar réglementaire version 2026.

Le début de la fin : classification et paperasse

Tout commence par une slide banale. Je dois préparer un deck pour un client sur l’analyse de données RH : scoring de CV, prédiction de churn. Tout cela semble innocent au premier abord, hein ? Sauf que qu’avec l’AI Act, c’est du “haut risque” pur jus (Annexe III, éducation, emploi, gestion des services publics). Article 6 en main, je classe mon système IA : “OK, gestion des risques, données de qualité, transparence, surveillance humaine…” EU AI Act Explorer

Je passe donc deux heures à documenter.

Quelles données d’entraînement ?

Ah, c’est du modèle fermé, je demande au provider, réponse:

Consultez nos docs.

Super.

Puis viens l’évaluation des biais : l’IA favorise les profils “parisiens” ? Test rapide, bingo, 15% de skew sur les régions.

Je corrige, je logge, je jure. À ce stade, mon café est froid et mon humeur au ras des pâquerettes.

Rappel: Guide Conformité AI Act 2026

L’IA contre-attaque : “Benoît, t’es obsolète”

Midi. Je demande à mon IA préférée de m’aider avec les slides. Je tape rapidement mon prompt :

Génère un plan percutant sur les tendances data 2026.

Elle me sort alors un truc nickel, en 30 secondes. Puis, innocemment, l’IA me glisse :

Suggestion d’optimisation : automatiser 80% de tes tâches récurrentes. Coût humain : 50k€/an. ROI en 3 mois.

Je rigole.

Et moi dans tout ça ?

La réponse est rapide …

Rôle évolué : supervision stratégique. Ou reconversion en prompt engineer.”

Là, je bloque.

L’Article 14 (surveillance humaine) me nargue : je dois rester aux commandes, mais elle est déjà meilleure. Et les nouvelles lignes directrices de la Commission du 23 février 2026 ? Elles précisent les “bacs à sable” pour tester ça en PME, mais moi, je ne suis qu’il modeste expert data qui galère déjà avec le registre EU (Article 49). Lignes directrices Commission UE

Afternoon chaos : interdictions et deadlines infernales

15h. Café n°3, cerveau en surchauffe. “Allez, un petit MVP (parce que POC c’est has-been) : un chatbot pour un client fictif qui répond aux FAQs data.” Je lance le prompt dans Claude :

Crée un assistant poli pour questions IA.

2 minutes plus tard, il me crache un code basique. Victoire !

Mais l’AI Act me saute alors à la gorge. Deepfakes intimes interdits ? Non, mais Article 50, transparence obligatoire pour tout chatbot. Je dois plaquer un disclaimer en gros : “Ce chat utilise de l’IA générative. Ne lui confiez pas vos secrets d’État.” OK, je colle ça. Test : “Bonjour, quel est le ROI d’un LLM ?” Réponse parfaite. “T’es génial !” lui dis-je. Elle : “Merci, humain. Note : je suis classé ‘minimal risk’, pas de panique.” EU AI Act Explorer

Puis le choc des deadlines. J’ouvre le calendrier officiel de mise en œuvre : interdictions générales déjà en vigueur depuis février 2025 (émotions deepfake, scoring social… check). GPAI (modèles comme GPT-4) à réguler depuis août 2025. Et haut risque (mon scoring RH) ? Deadline impitoyable : 2 août 2026. On est le 3 mars. Cinq mois. Cinq petits mois pour audits, registres, tout le bazar. Mon estomac se noue. AI Act Timeline

Et les amendes pour finir en beauté ? Article 101 : 35 millions d’euros ou 7% du CA mondial. Pour une multinationale genre OpenAI, OK. Pour moi, solo data à Mantes-la-Jolie ? Le “non-respect formel” Article 83 : jusqu’à 15 millions quand même. “Benoît”, je m’entends marmonner, “t’as pas ça sur ton Livret A.”

L’IA, sentant (bon elle ne sent rien bien sur mais c’est pour le narratif ;-) ) ma panique, intervient : “Recommandation prioritaire : migrez vers un modèle souverain UE (ex. Mistral, Aleph Alpha) pour contourner les risques extra-européens et valider Article 7 sur la traçabilité.” Facile à dire, quand ton abonnement ChatGPT coûte 20€/mois et fait le taf. “T’es mon coach conformité maintenant ?” Elle : “Oui. Prochaine étape : évaluer vos biais culturels.” Je ferme l’onglet. Victoire pyrrhique de l’humain. Guide Conformité AI Act

Épilogue : l’humain gagne… pour l’instant

Fin de journée. J’éteins l’écran. L’AI Act protège (biais, transparence, risques systémiques), c’est clair. Mais pour un data worker comme moi, c’est un sport extrême : gouvernance des données (Article 10), cybersécu (Article 15), évaluation d’impact droits fondamentaux (Article 27). Les sandboxes et guidelines pour PME aident, mais franchement, qui a le temps ? Ajustements Parlement UE

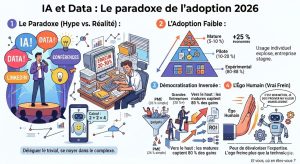

Pourtant, force est de constater : sans ça, on court vers le chaos. Gartner prédit en effet 30% des boîtes en infraction d’ici 2027. Alors, on râle, on rit jaune, mais on s’y plie. Et si l’IA m’a “viré” aujourd’hui, demain, c’est moi qui la pilote. Ou pas. Et si l’avenir des expert data était de plus de savoir jongler dans le chaos juridique que dans la data elle-même ?

Et vous, vous en êtes où avec l’AI Act ? Déjà classé vos outils, ou vous attendez août 2026 comme un funambule ? Dites-moi en coms, je suis curieux !

(Sources clés : EU AI Act Explorer, Timeline mise en œuvre, lignes directrices Commission 2026.)